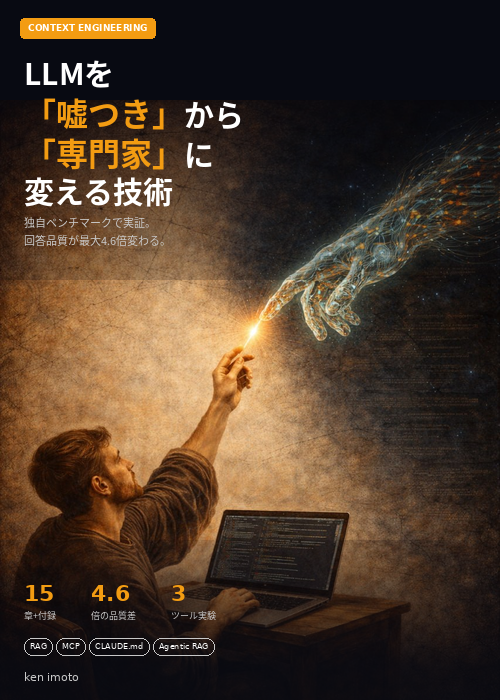

LLMを「嘘つき」から「専門家」に変える技術

Context Engineering 実践入門

Context Engineering 実践入門 | RAG・MCP・CLAUDE.md・Agentic RAG をベンチマークで体系化

Context Engineering 軸の【独立体系】RAG/MCP/CLAUDE.md を実証データで束ねる側 (ハーネス3部作とは別軸)

本書の概要

「同じ質問なのに、AIの回答が全然違う」原因はプロンプトではなくコンテキストにあります。架空の社内ツール3つで独自ベンチマーク実験を行い、コンテキスト戦略でAIの回答品質が最大4.6倍変わることを定量実証。「大規模モデルほど上手に嘘をつく」「小さいモデル+RAG > 大きいモデル単体」など衝撃の結果と、5段階のコンテキスト戦略・RAG・MCP・CLAUDE.mdまで体系的に解説。

この本でできるようになること

- 5段階のコンテキスト戦略を理解し、品質を2.2倍以上に引き上げられる

- RAG が効果の8割を占める理由と、ブレイクスルーポイントを実装できる

- MCP (Model Context Protocol) サーバーを設計・運用できる

- CLAUDE.md の段階的設計パターンで、プロジェクト文脈を最適化できる

- Agentic RAG を Python で実装できるようになる

対象読者

- 【中級エンジニア】プロンプトエンジニアリングの次のステップを知りたい人

- 【LLM活用検討中】RAG / MCP の使い分けを掴みたい人

- 【ハルシネーション対策中】「大規模モデルでも間違える」現象に困っている人

- 【Claude Code利用者】CLAUDE.md の段階的設計を学びたい人

- 【AIエージェント開発者】Agentic RAG を実装したい人

- 【ベンチマーク志向】定量的にコンテキスト戦略を比較したい人

この本で解決できる悩み

- プロンプトを工夫しても、AIの回答品質が安定しない

- RAG を実装したが、本当に効果が出ているのか分からない

- MCP サーバーを使うべきか、RAG だけで十分か判断できない

- CLAUDE.md にどう情報を載せれば最大化できるか分からない

- Agentic RAG という言葉は聞くが、普通の RAG と何が違うのか

- LLM を切り替えるたびに回答品質が変わって困る

この本の立ち位置

- ベンチマーク重視 (4.6倍の品質差を実験で実証)

- Context Engineering 特化 (プロンプト・ハーネスとは別軸の独立体系)

- 中級者向け (LLMを使ったことがある前提、RAG入門ではなく実践)

- Python 実装込み (96の本番品質コードファイルがGitHub公開)

なぜこの本か

- 独自ベンチマークで「コンテキスト戦略で品質が4.6倍変わる」を定量実証

- 「大規模モデルほど上手に嘘をつく」「小さいモデル+RAG > 大きいモデル単体」を実験で示す

- RAG / MCP / CLAUDE.md / Agentic RAG を1冊で網羅

- GitHub に96の本番品質コードを公開、再現可能な学習体験

- Claude Code との連携 (CLAUDE.md 段階的設計) を扱う

他のAI本との違い

| 比較対象 | 本書の違い |

|---|---|

| プロンプトエンジニアリング書籍 | プロンプト以前の「コンテキスト設計」に焦点。プロンプトの先のレイヤーを扱う。 |

| RAG 入門書 | RAG 単体ではなく、RAG / MCP / CLAUDE.md / Agentic RAG を統合した Context Engineering の体系として整理。 |

| ベンダー公式ドキュメント (OpenAI / Anthropic 等) | 独自ベンチマークによる定量実証。「実際に何倍変わるか」を実験で示す。 |

目次

- 01 扉 無料公開

- 02 はじめに 無料公開

- 03 5つの回答 — 同じ質問に5パターン 無料公開

- 04 LLM は嘘をつく — ハルシネーションの正体

- 05 Context Engineering の始まり

- 06 ファーストステップ — ゼロショットから戦略へ

- 07 Few-Shot — 例示で品質を上げる

- 08 RAG — 効果の8割を占める手法

- 09 フル Context Engineering — 5段階を統合

- 10 MCP — Model Context Protocol サーバー設計

- 11 Memory — 継続するコンテキスト

- 12 (以下続く、計22章+付録A)

「同じ質問をしているのに、AIの回答が全然違う」。原因は、プロンプトではなくコンテキストにあります。

本書では、架空の社内ツール3つを使った独自ベンチマークで、コンテキストの与え方によってAIの回答品質が 最大4.6倍変わる ことを定量実証しました。「大規模モデルほど上手に嘘をつく」「小さいモデル+RAG > 大きいモデル単体」という結果をもとに、Context Engineering の全体像を整理しています。

5段階のコンテキスト戦略、RAG (効果の8割)、MCP サーバー設計、CLAUDE.md の段階的設計、Agentic RAG 実装まで。プロンプトエンジニアリングの次の手を、実験データと96の本番品質コードで掴める1冊です。

「大規模モデルほど上手に嘘をつく。だから、コンテキストで真実を与える。」

シリーズ・関連書籍

関連記事で深掘りする

Kindleで購入する

Kindle Unlimitedで読み放題対象

Kindleで購入する (¥1,500) トピック: Context EngineeringRAGMCPLLMベンチマーク